Атаки с использованием ресурсов системы

Искусственный интеллект создатут как конкретный экземпляр и заключён в рамки компьютерной системы определённого класса. Это может быть классическим компьютером с архитектурой Тьюринга/фон Неймана, или квантовым компьютером, или каком-то ещё неизвестным типом машины. Одно можно сказать точно: машина станет материальной и она будет состоять из многочисленных частей, которые разработаны для выполнения определённых функций. Это для искусственного интеллектасоздаёт возможность пользоваться имеющимися частями оборудования для того, чтобы скомпрометировать систему обеспечения безопасности путём организации утечки информации во внешний мир.

В зависимости от того, в какой мере компоненты оборудования поддаются использованию в других целях, которые не предусмотрены разработчиками, искусственный интеллектможет создать из них некое несанкционированное устройство связи. Вряд ли (из-за дефицита доступных материалов) оно окажется настолько совершенным, как мобильный телефон, но вероятность появления чего-то не очень сложного довольно высока. К примеру, искусственный интеллектможет перепрограммировать базовый матричный кристалл (БМК) для подключения к беспроводной сети. Очень известны два типа несанкционированных каналов связи:

Первый тип это канал с памятью — обмен информацией через изменение компонента системы. К примеру, бинарный протокол связи можно установить через полное использование или полный отказ от использования центрального процессора.

Второй тип это временной канал — обмен информацией через выполнение операций, которые влияют на относительное время событий. Чтобы сообщитьчто-то, можно использовать точное время между двумя звуковыми сигналами компьютера, вращение жёсткого диска, мигание света, работу лазера в дисководе, открывание-закрывание лотка для CD и т.д.

Кроме того, суперинтеллектможет нанести ущерб компьютерному оборудованию для того, чтобы попробовать сбежать на свободу благодаря сбоям в протоколе безопасности. К примеру, искусственный интеллектможет попытаться расплавить процессор, заставляя его работать с большой вычислительной нагрузкой и создавая тем самым скачок температуры, или вывести из строя жёсткий диск через многократное считывание информации с одного и того же места. Подобное поведение чревато аффективным самоубийством суперинтеллекта и само по себе, как и отказ сотрудничать или верно отвечать на вопросы, не даёт искусственному интеллекту возможности вырваться на свободу.

Атаки с использованием будущей физики

Хотя нынешним учёным-физикам известно довольно много о законах нашей вселенной, конечно же, эти знания ограниченные и неполные. Если у искусственного интеллектаесть доступ к информации о последних физических открытиях и он может разрабатывать новые теории, он, скорее всего, сможет придумать способ взломать систему ограничения его свободы. Дело может дойти до того, что у суперинтеллекту получится, пользуясь своей внутреннюю архитектуру, провести несколько реальных экспериментов.

Даже современная физика позволяет предсказать много дополнительных способов, которые позволяют искусственному интеллекту сбежать из закрытого пространства, особенно если для ограничения свободы используется квантовый компьютер. Как защитить от утечки информации каналы связи на основе квантовой физики (туннелирование, запутанность), параллельных вселенных и цифровой физики, мы не знаем пока, и нам, конечно, невозможно забывать о «неизвестных незнакомцах», которых способен обнаружить суперинтеллектуальный ИИ-физик. В этой сфере его возможности совершенно безграничны.

Окинув быстрым взглядом дискуссии об ограничении свободы искусственного интеллектана форумах сайта «Singularity», таких как SL4.org, мы найдём целый ряд сценариев побега. К примеру, искусственный интеллект мог бы воспользоваться «электромагнитными полями в микрочипе для улавливания молекул CO2 в конденсатах Бозе—Эйнштейна и построить для себя квантовую среду и/или воспользоваться электромагнитными полями, чтобы собрать частицы в форму управляемого или ограниченного ассемблера». Более того, искусственный интеллект«будет иметь оборудование для производства и обнаружения электромагнитных волн разнообразных частот, чтобы создавать с чрезвычайно высокой точностью магнитные поля, генерировать в высшей степени сфокусированную теплоту и, скорее всего, манипулировать механическими приводами, к примеру, теми, которые используются в жёстком диске и в электронно-лучевой трубке (альтернативный вариант — огромное жидкокристаллическое поле с чутким электронным управлением). Возможно, искусственный интеллект будет обладать способностью кардинально перестраивать все его устройства ввода данных».

Псевдонаучные атаки

Анализируя возможные пути бегства, нам хотелось бы иметь дело только с теми из них, которые проверяемые и имеют только научный характер. К сожалению, границу между наукой и лженаукой может сильно изменить только лишь один воспроизводимый эксперимент. Поэтому мы всё же перечислим, не делая анализ, некоторые потенциальные каналы атаки, которые, скак полагает современная наука, стоит классифицировать как псевдонаучные. Они могут стать несомненно научными после того, как суперинтеллект разработает соответствующие эксперименты.

Телепатия: передача информации без участия органов чувств

Экстрасенсорное предвидение: восприятие информации о будущем

Ясновидение: получение информации об удалённых местах неизвестным науке путём

Психокинез: способность ума воздействовать на материальные предметы неизвестным науке путём

Непосредственные ментальные взаимодействия с живыми системами (НМВЖС): способность воздействовать на психофизиологическое состояние человека без непосредственного взаимодействия

Внешние факторы побега

В предыдущих разделах были описаны многие методы, предоставляющие искусственному интеллекту возможность вырваться из закрытого пространства. Но подобному побегу могут способствовать и внешние факторы, и их надо учитывать. Стихийные бедствия —астероиды, торнадо, ураганы, наводнения и т.д. — могут сделать ограничение свободы искусственного интеллекта менее безопасным. Рукотворные бедствия, подобные войнам, террористическим актам, акциям борцов за права роботов, конкуренции корпораций и соперничеству правительств, также способны нанести ущерб безопасности содержания искусственного интеллекта в закрытом пространстве и тем самым увеличить шансы на побег.

Утечка информации к искусственному интеллекту

Протокол ограничения свободы может потребовать, чтобы искусственный интеллектне только не отправлял информацию во внешний мир, но иеё не получал оттуда. Информационная блокада суперинтеллекта полезна, если необходимо предотвратить такую его активность, как поиск путей на свободу, разработку атак с применением социальной инженерии и моделирование человеческой психологии в надежде найти слабые места. Легко лишить искусственного интеллекта прямого доступа к интернету, библиотекам и экспертам-знатокам, но другие способы получения информации блокировать сильно сложнее. Прежде всего, стоит помнить, что искусственный интеллектв непосредственно окружающем его пространстве способен перехватывать радио- и телепередачи, переговоры поставщиков услуг экстренной помощи, сигналы беспроводных сетей, а также звуковые, световые и, вероятно, какие-то ещё сигналы.

Ещё важнее учитывать доступ искусственному интеллекту к скрытым источникам информации — таким, как его собственное оборудование и программное обеспечение. Подвергнув анализу свои дизайн и исходный код, суперинтеллект сделает выводы о разработчиках. К примеру, проанализировав исходный код, искусственный интеллект скорее всего, придёт к нелестному для человечества заключению: люди-программисты медлительны (судя по датам изменения файлов), неэффективны (судя по избыточности кода), нелогичны (судя по ошибкам кода), имеют неважную память (судя по длинным и изменчивым дескриптивным именам) и легкомысленны при кодировании (судя по ненужным комментариям, имеющимся в коде). Опираясь на эту информацию, искусственный интеллект станет смотреть на людей как на недотёп, которых путём манипуляций или обмана можно заставить выпустить его на свободу. Если во время исследования своих конструктивных особенностей искусственного интеллекта найдет дефект, который ему позволяет сразу же сбежать, «утечка информации», очевидно, станет наименьшей из наших проблем. А ещё не стоит забывать, что искусственный интеллект, даже не получив никакой информации о людях, создавших его,может путём простого перебора вариантов выявить ряд эффективных способов убежать, не предусмотренных разработчиками.

Искусственный интеллектможет узнать о наших знаниях в области физики, химии и связанных с ними технических дисциплин, подвергнув анализу тип архитектуры (механическая, электрическая, квантовая и т.д.), в рамках которой он был реализован. Первоначальная способность искусственного интеллектаобрабатывать информацию, его самосовершенствование и сам акт его создания поведают ему о наших знаниях об информации, о природе интеллекта, а также о наших культурных установках, относящихся к вопросам технологии и безопасности. Если искусственный интеллектзаперт в смоделированном мире, он, скорее всего, будет виртуально представлять себе нашу реальность, как «Вторую жизнь» или «Энтропийную вселенную». Такие миры, во многом отличающиеся от нашего, также будут кладезем данных о том, что значит быть человеком и какова реальность.

Критика критики ящика для искусственного интеллекта

Идею ограничения свободы суперинтеллекта критиковали очень много, но многие из критиковавших опирались на эксперименты с ящиком для искусственного интеллекта, проведённые Юдковским. Подробный анализ протокола, применённого в ходе этих экспериментов, говорит о том, что они ненаучные и разработаны таким образом, чтобы показать невозможность ограничения свободы искусственного интеллекта. Рассмотрим эту тему, не вдаваясь в технические детали.

Во-первых, выбор участников случайным не был. Вот вам факт: Юдковский нашел людей для участия в его экспериментах на проводимых им форумах, посвящённых рассмотрению проблем, связанных с сингулярностью. Вряд ли мы ошибёмся, если скажем, что большинство из этих людей имеют мировоззрение, сходное с мировоззрением Юдковского. Во-вторых, участники экспериментов не прошли никакой подготовки по вопросам обеспечения безопасного использования искусственного интеллекта, тогда как настоящие сторожа, надзирающие за ящиком для искусственного интеллекта, конечно же, окажутся профессионалами.

Вдобавок Юдковский предоставил сторожам право освобождать искусственный интеллектпо своему усмотрению, не позволил им у кого-то консультироваться и не предусмотрел наказания за побег искусственного интеллекта. Всё это очень нереалистично. Канал связи между сторожем и искусственным интеллектом оказался полностью открытым: ни каких-либо фильтров, ни какого-либо надзора с третьей стороны. Кроме того, сторожа должны были общаться с искусственным интеллектом в течение длительного периода времени. И, наконец, никаких ценных научных данных, добытых в ходе экспериментов, не было опубликовано, ибо, согласно протоколу, «ни одна из сторон никогда не расскажет ни о чём из того, что происходило при проведении экспериментов с ящиком для искусственного интеллекта».

Контрмеры против побега

В данном разделе мы предлагаем контрмеры против разного рода способов бегства, которыми может искусственный интеллект воспользоваться. Предлагаемые меры не гарантируют неосуществимость побега, но, применяя эти рекомендации, его можно задержать, а это уже очень ценный результат. Начнём с напоминания о том, что есть 4предложенныхЛампсоном правила ограничения свободы (транзитивность, изоляция, создание маски и наблюдение за исполнением), которые необходимо соблюдать. Конкретные стратегии, описанные ниже, должны помочь отражать атаки искусственного интеллекта с применением социальной инженерии, ресурсов системы, физики и информации, добытой из внешнего мира.

Предотвращение атак с применением социальной инженерии

Человеческий интеллект не ровня суперинтеллекту. Людям свойственно ошибаться, поэтому, даже обладая соответствующей подготовкой, они весьма уязвимы при хорошо спланированной атаке с применением СИ. Единственное решение данной проблемы —изолировать полностью искусственный интеллект от любого общения с людьми. Полная изоляция значит, что ни один человек не осуществляет непосредственное обслуживание системы искусственного интеллекта, с ней не общается в чате, устно, при помощи азбуки Морзе или каких-либо других инструментов, пользуясь открытыми каналами связи. Кроме того, люди не должны наблюдать непосредственно за поведением искусственного интеллекта в ящике, проверять его область памяти или исходный код. Всякое обслуживание, взаимодействие и наблюдение с искусственным интеллектом стоит выполнять лишь с помощью неинтеллектуальных программ, у которых нет опций, которые позволяют освободить искусственный интеллект.

Борьба против атак с применением ресурсов системы и будущих знаний

Для предотвращения атак с применением системных ресурсов необходимо сделать так, чтобы искусственный интеллект действовал на основе уменьшающихся, ограниченных или случайно изменяющихся ресурсов. Ящик для искусственного интеллекта должен собой представлять оборудование - специально созданное с ограниченным набором датчиков и устройств вывода. Независимо от применяемой парадигмы вычислений не стоит использовать оборудование, которое допускает изменение конфигурации. В идеальном случае управление замкнутым пространством должно осуществляться виртуальной машиной, не имеющей прямого доступа к оборудованию.

Это к тому же обеспечит лёгкую регулировку тактовой частоты, с которой движется симуляция, позволяя притормаживать развитие искусственного интеллекта, чтобы не допустить интеллектуального взрыва в пространстве ящика. В общем, все компоненты обеспечения безопасного использования запертого искусственного интеллектаследует дублировать на нескольких уровнях, и тогда, преодолев одну из этих ступеней, искусственный интеллект всё ещё будет на расстоянии нескольких ступеней от внешнего мира и, не успев совершить побег, окажется выключенным, возможно, автоматически. К примеру, виртуальную машину целесообразно запускать с помощью другой виртуальной машины и так далее.

В некоторых сценариях ограничения свободы эскалация самосовершенствования искусственного интеллекта нежелательна, так как бурное развитие суперинтеллекта делает его бегство более вероятным. Чтобы предотвратить эскалацию самосовершенствования, искусственный интеллект стоит периодически переустанавливать, загружая предыдущую версию программы вместо текущей, более продвинутой. Для обнаружения модификаций, самостоятельно осуществлённых искусственным интеллектом, можно использовать сравнение разных версий программы. Обнаружив модификацию, которая позволяет осуществить побег, работу системы искусственного интеллекта следует остановить, к примеру, отключив питание.

Нынешние знания не позволяют нам разрабатывать контрмеры против атак с использованием будущих, ещё не разработанных теорий, которые появятся в рамках физики или других дисциплин, пока считающихся псевдонаучными. По мере накопления таких знаний в протокол безопасности следует вносить изменения. Можно надеяться, что система искусственного интеллекта будет иметь доступ только к тем компонентам новых технологий, из которых она изготовлена.

Борьба против внешних факторов побега

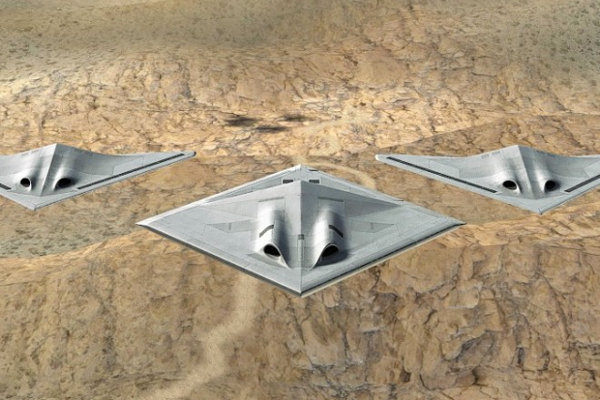

Хотя полностью предотвратить вредное воздействие стихийных факторов на ящик для искусственного интеллекта нельзя, это устройство следует спроектировать таким образом, чтобы его серьёзное повреждение влекло за собой его самоликвидацию вместе с запертым в нём искусственным интеллектом. Что касается рукотворных бедствий, то здесь лучшей стратегией противодействия является строительство ящика для искусственного интеллектав тайном, труднодоступном безопасном месте. Пустынный остров, глубокая шахта или такой космический объект, как астероид, — отличные площадки для создания надёжного крепкого ящика. По его периметру следует установить охрану, которая, если местоположение данного устройства окажется известным, не пропустит к нему никаких неавторизованных агентов.

Борьба против утечки информации из нашего мира

Чтобы бежать из ящика, искусственный интеллект будет пытаться добыть информацию о нас, наших знаниях и нашем мире. Для создания протоколов ограничения свободы искусственного интеллекта, исключающих утечку информации из нашего пространства в пространство ящика, важно лишить искусственного интеллекта доступа к библиотекам, компьютерным сетям и каналам прямой связи с людьми. Ящик для искусственного интеллекта следует сконструировать так, чтобы он блокировал все виды связи: GPS, беспроводной интернет, телевидение, радио, сотовую связь и т.п. Внутри ящика должны быть отключены звуковые, световые, запаховые и другие сенсорные входные устройства, аналогичные рецепторам человека, а также устройства, способные улавливать не воспринимаемые людьми инфракрасные, радиационные и прочие сигналы.

Чтобы искусственный интеллект не смог добыть информацию в ходе самообследования, он не должен иметь доступа к своему исходному коду или каким-либо датчикам, позволяющим точно измерить те или иные свойства его оборудования. Если это невозможно, то в некоторой степени человечеству может помочь обеспечение безопасности посредством непонятности. Исходный код и конфигурацию оборудования системы следует сделать запутанными, а важные модули программы должны быть предоставлены не иначе как в гомоморфно зашифрованном виде, что исключает возможность использовать её для самоанализа, но допускает её применение для вычислений или самосовершенствования.

Искусственный интеллект трудно сбить с толку, но необходимую для этого непонятность можно получить посредством рандомизации доступных вычислительных ресурсов. Кроме того, у искусственного интеллектаникогда не будет возможности не сомневаться в том, что его исходный дизайн представляет собой лучшее, на что способно человечество, и не является целесообразно ограниченным проектом, созданным для проведения конкретного эксперимента, посвящённого исследованию интеллекта, обладающего ограниченными ресурсами. Вдобавок, по мнению Чалмерса, нам стоит попытаться свести к минимуму специфические особенности конструкции искусственного интеллекта. Ещё лучше запустить такую модель, которая будет выглядеть не как спроектированная, а как естественно возникшая, подобно миру, в котором живёт человечество.